Künstliche Intelligenz ist 2026 für viele Unternehmen kein Experiment mehr, sondern Wachstumstreiber: Expertinnen und Experten von Capgemini und Praxisfälle wie ABN AMRO zeigen Wege, wie Pilotprojekte in skalierbare KI-Systeme überführt werden können. Entscheidend sind dabei technische Architektur, kontinuierliche Modellpflege und organisatorische Steuerung, damit Automatisierung und Maschinelles Lernen dauerhaft Mehrwert liefern.

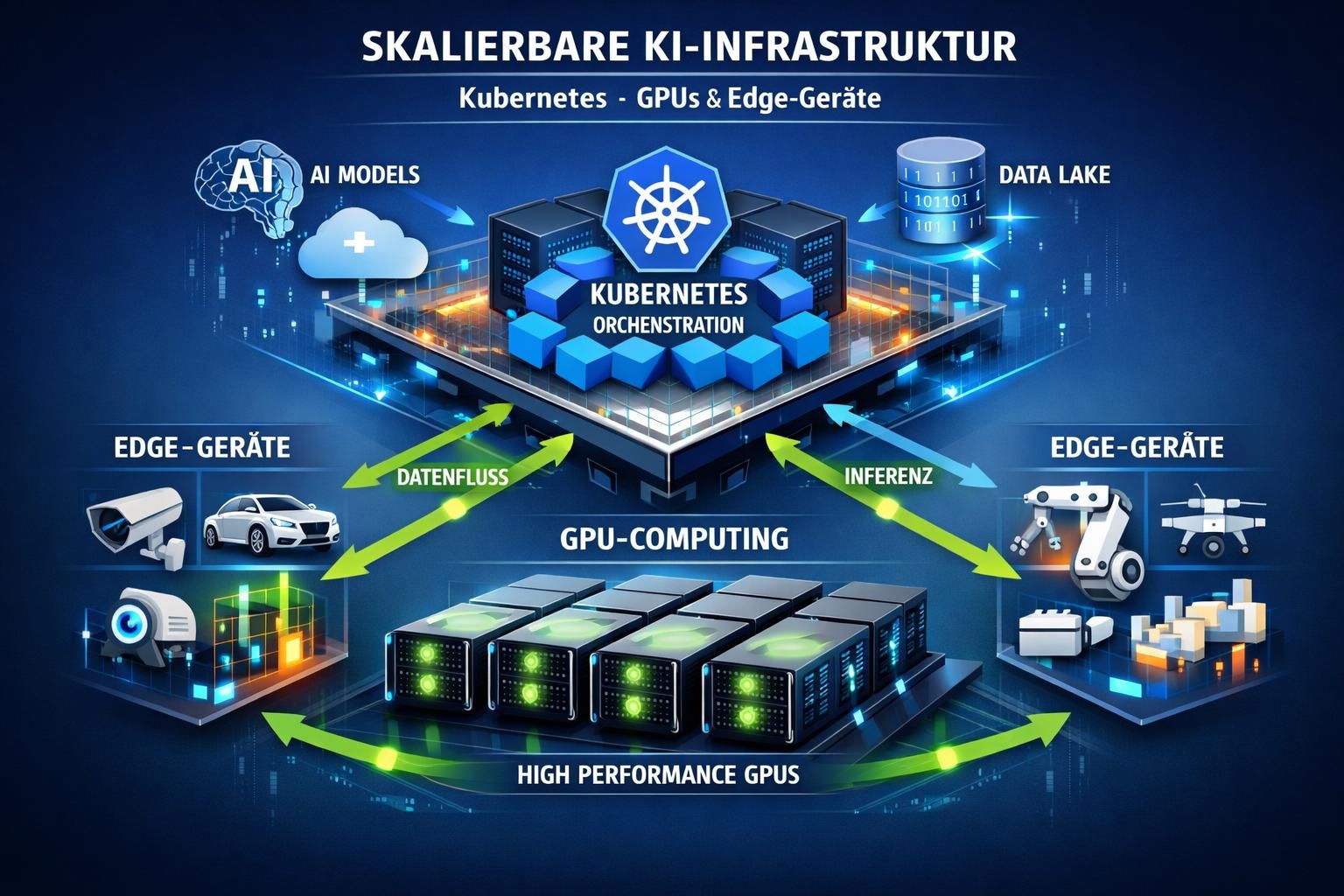

Technische Infrastruktur für die Skalierung von KI-Systemen und Latenzoptimierung

Unternehmen müssen bei der Skalierung von KI-Systemen vor allem Rechenleistung, Latenz und Datenmanagement harmonisieren. In der Praxis bedeutet das den Einsatz von Caching, Container-Technologien wie Kubernetes und spezialisierter Hardware (GPUs, TPUs), um Anfragen parallel zu verarbeiten und Engpässe zu vermeiden.

Konkrete Maßnahmen reichen von intelligentem Request-Caching bis zur Teilverlagerung von Inferenz an den Edge mittels Edge-KI und FPGAs, um Antwortzeiten in Echtzeit-Anwendungen zu reduzieren. Diese Kombination ist oft kosteneffizienter als allein die Investition in größere Serverkapazitäten.

Das Ergebnis: kürzere Latenzen, höhere Systemverfügbarkeit und eine robustere Basis für Produktivsetzungen. Dieser Architekturansatz beeinflusst direkt die Wettbewerbsfähigkeit bei digitalen Produkten und Services.

Praxisbezug und Auswirkung auf Technologieentwicklung

Bei Produktionen mit hohen Lastspitzen sorgt die Parallelisierung der Inferenzprozesse dafür, dass Modelle auch unter Volllast zuverlässig bleiben. Die technische Wahl wirkt sich unmittelbar auf Betriebskosten und Time-to-Market aus.

Insight: Eine durchdachte Kombination aus Containerization und Edge-Strategien reduziert Latenzen stärker als reine Hardware-Scaling-Maßnahmen.

Modellpflege, Drift-Erkennung und fortlaufende Optimierung

Langfristige Genauigkeit erfordert kontinuierliches Monitoring gegen Model Drift und Concept Drift. Drift-Detection-Verfahren vergleichen Live-Daten mit historischen Vorhersagen, um Leistungseinbrüche frühzeitig zu identifizieren.

Unternehmen setzen zunehmend auf Active Learning, Online Learning und Human-in-the-Loop-Prozesse, damit Modelle durch gezieltes Nachtrainieren und Expertenfeedback aktuell bleiben. Solche Workflow-Elemente sind Teil einer nachhaltigen Systemintegration.

Fehlannahmen wie das Vertrauen auf statische Modelle werden durch Praxisfälle widerlegt: ohne regelmäßiges Nachtrainieren drohen Fehlentscheidungen im Betrieb. Gutes Monitoring senkt Risiko und erhöht die Akzeptanz bei Fachbereichen.

Konkrete Folgen für Automatisierung und Datenmanagement

Organisationen, die kontinuierliche Lernzyklen etabliert haben, sehen stabilere Automatisierungsprozesse und geringere Ausfallraten. Ein robustes Datenmanagement ist dabei die Grundlage für belastbare Retrainings und auditable Entscheidungen.

Insight: Kontinuierliche Modellpflege ist kein Nice-to-have, sondern Kernanforderung für produktive KI-Systeme.

Organisation, Governance und ökonomische Argumente für die Skalierung

Die Transformation zur unternehmensweiten KI-Einführung ist gleichermaßen technisches und organisatorisches Projekt. Capgemini-Analysen zeigen, dass rund 80 % der Unternehmen ihre Investitionen in generative KI erhöht haben, und etwa ein Viertel die Lösungen bereits operativ nutzt. Als Ergebnis werden Produktivitätsgewinne und bessere Kundenerlebnisse dokumentiert.

Ein konkretes Beispiel ist die Zusammenarbeit zwischen ABN AMRO und Capgemini: Governance-Richtlinien, definierte KI-Grundsätze und iterative Feedbackschleifen sicherten dort die Skalierung in Kundenkontaktprozessen. Solche Governance-Elemente sind zentral für verantwortungsvolle Systemintegration.

Auch die Entwicklung neuer Kompetenzen bleibt ein kritischer Faktor; Unternehmen investieren in Weiterbildung und rollen neue Rollen wie MLOps oder Data Engineering aus. Hierzu finden sich praktische Hinweise zu nötigen Fähigkeiten auf spezialisierten Plattformen.

Insight: Ohne klare Governance, KPIs und Schulungspläne bleibt Skalierung technisch möglich, aber wirtschaftlich riskant. Zur Vertiefung siehe Performance-KPIs für KI-Integration und die Analyse zu neuen Kompetenzen für KI.